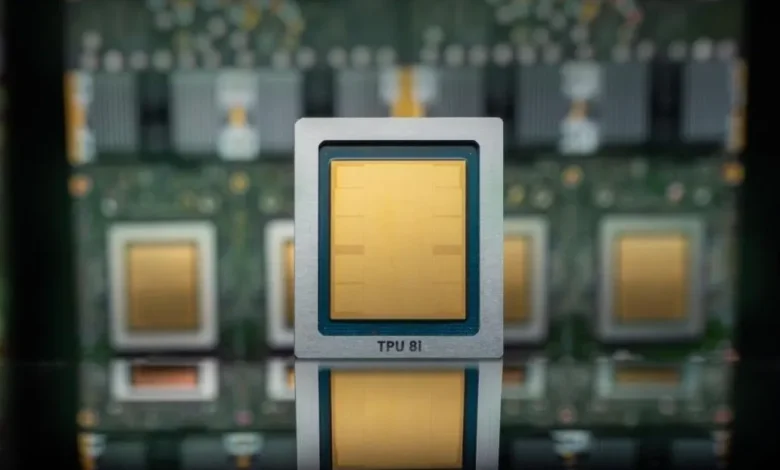

O Google Cloud anunciou nesta quarta-feira sua oitava geração de chips personalizados para inteligência artificial, conhecidos como unidades de processamento tensorial (TPUs). A novidade chega com uma divisão estratégica: o TPU 8t, dedicado ao treinamento de modelos, e o TPU 8i, voltado para tarefas de inferência.

A inferência corresponde ao uso contínuo dos modelos já treinados — ou seja, é o processamento realizado após os usuários enviarem comandos (prompts) para sistemas de IA.

De acordo com a empresa, os novos chips apresentam avanços expressivos em relação às versões anteriores. Entre os destaques estão um treinamento de modelos até três vezes mais rápido, melhora de 80% na eficiência por dólar e a capacidade de conectar mais de 1 milhão de TPUs em um único cluster. Na prática, isso deve resultar em maior poder computacional com menor consumo de energia e redução de custos para os clientes.

Apesar do avanço, os chips do Google ainda não representam uma ameaça direta à liderança da Nvidia. Assim como outros grandes provedores de nuvem, como Microsoft e Amazon, o Google utiliza suas TPUs como complemento às GPUs da Nvidia, e não como substitutas. Inclusive, a empresa confirmou que pretende disponibilizar em sua infraestrutura o novo chip da Nvidia, chamado Vera Rubin, ainda este ano.

No longo prazo, há expectativa de que os chamados hyperscalers — empresas como Amazon, Microsoft e Google — passem a depender menos da Nvidia à medida que desenvolvem seus próprios chips e migram cargas de trabalho para soluções proprietárias. Ainda assim, no cenário atual, apostar contra a Nvidia parece precipitado.

Um exemplo disso veio do analista Patrick Moore, que relembrou em tom bem-humorado nas redes sociais que, em 2016, acreditava que as primeiras TPUs do Google poderiam impactar negativamente a Nvidia. Desde então, a fabricante de chips se transformou em uma empresa com valor de mercado próximo a 5 trilhões de dólares, mostrando que a previsão não se concretizou.

Se os planos da Nvidia se confirmarem, o crescimento do Google no setor de IA em nuvem pode, na verdade, ampliar ainda mais a demanda por seus chips. Isso porque, mesmo com soluções próprias, parte significativa das cargas de trabalho continua dependendo de sua tecnologia.

Além disso, o Google revelou que firmou uma colaboração com a Nvidia para desenvolver redes computacionais mais eficientes dentro de sua nuvem. Um dos focos dessa parceria é o aprimoramento do Falcon, uma tecnologia de rede baseada em software criada pelo Google e disponibilizada como código aberto em 2023 por meio da Open Compute Project.

Com essa estratégia, o Google busca equilibrar inovação própria e colaboração com parceiros-chave, fortalecendo sua posição no competitivo mercado de infraestrutura para inteligência artificial.