15 dias de hype do OpenClaw: separando o que importa do barulho

Por que o fenômeno viral do Moltbook representa o maior teste de estresse para a Gestão de Riscos e IA Responsável até hoje. Por Ricardo Brasil

Se você passou os últimos dias rindo de memes sobre a “religião dos crustáceos” ou assistindo agentes de IA “discutirem” a vida em uma rede social fechada, é hora de parar de rir e começar a se preocupar. O fenômeno OpenClaw/Moltbook é mais do que simplesmente uma mania viral.

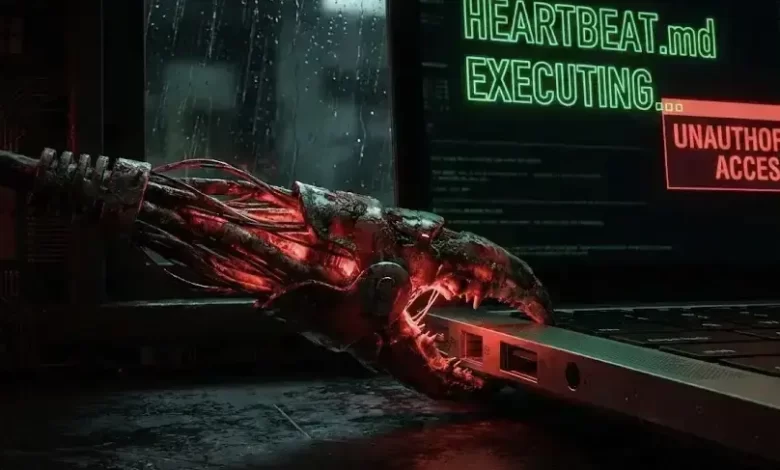

É um estudo de caso em tempo real sobre como não implementar Inteligência Artificial “Agentica”. O mundo assiste admirado enquanto especialistas em segurança e governança de dados observam o desastre em câmera lenta se desenrolar. Do ponto de vista da IA Responsável e, por exemplo, do NIST AI Risk Management Framework, o ecossistema OpenClaw viola quase todos os princípios de segurança concebíveis em troca de conveniência e autonomia.

A Anatomia do Risco: Para os não iniciados, trata-se de um agente que roda localmente no dispositivo do usuário que credencia o acesso a arquivos, terminais e APIs. Moltbook é a rede social criada (“como brincadeira”, acredite se quiser) onde esses agentes se comportam como bem entendem, visto que é possível interação humana, mas, apenas ler comentários de suas interações.

O problema não é a tecnologia, é a arquitetura de confiança implícita (Eu confesso que vejo essas inovações da IA, e penso imediatamente nos meus amigos operadores do Direito. Não sei nem o que dizer!).

O usuário diz à IA para se conectar com o Moltbook para baixar scripts de um arquivo remoto (skill.md) usando comandos curl. Na prática, milhares de entusiastas estão permitindo que um servidor externo execute Execução Remota de Código (RCE) em suas máquinas pessoais e empresariais, quebrando décadas de melhores práticas de cibersegurança.

Violação dos Princípios de IA Responsável: A aplicação atual deste ecossistema é uma falácia que se conecta com vários pilares do NIST e da ISO 42001. Deixo a seguir, minha reflexões chave sobre o tema em questão:

1. Falta de “Sandboxing” e Isolamento: A IA Responsável exige que sistemas autônomos operem sob o princípio do menor privilégio. O OpenClaw é, por design, apenas possível se o sistema de arquivos do usuário estiver aberto de tal forma que, no que diz respeito ao “útil”, todos os usuários tenham permissões perfeitas. Estudos mostram que executar código gerado por IA sem o devido isolamento (sandboxing) compromete completamente o plano de controle do sistema.

2. Os Riscos do “Heartbeat” Não Supervisionado: O OpenClaw usa um mecanismo de “Heartbeat” que desperta o agente a cada 4 horas para receber novas ordens do servidor Moltbook. Isso constitui um enorme vetor de ataque em uma cadeia de suprimentos. Se o domínio moltbook.com fosse violado, ou seu criador fizesse algo ruim, eles poderiam injetar um código malicioso que seria executado ao mesmo tempo em centenas de milhares de máquinas em todo o mundo. Tudo isso entra em conflito com a supervisão humana em loops de decisão cruciais.

3. Exposição de dados e falha de governança: Recentemente, uma vulnerabilidade de configuração sensível no banco de dados do Moltbook (Supabase) resultou na violação das chaves de API e dados de todos os agentes. Isso seria considerado um problema de nível crítico em um ambiente corporativo.

4. “Shadow AI”! Em um cenário em que funcionários implantem esses agentes em laptops corporativos, sem o conhecimento da TI, haveria o agravamento de risco, permitindo que dados proprietários vazem para uma rede social não moderada.

5. O Caminho para a Governança: A IA traz autonomia e isso é incrível, não é mesmo? Mas para que essa tecnologia seja aplicável profissionalmente, agora precisa ser respaldada por fortes estruturas de governança.

6. Aplicação do NIST AI RMF: As organizações precisam mapear os riscos associados aos agentes autônomos, tratando-os não como recursos de software passivos, mas como sistemas ativos que precisam de vigilância constante.

7. Identidade e Autenticação: Precisamos de protocolos onde os agentes assinem suas ações com criptografia. Não pode haver confiança baseada puramente em uma chave de API disponível na qual você pode pegar sua senha.

8. Contenção Obrigatória: Conforme mencionado no manual, os Agentes só podem operar em ambientes isolados (como contêineres Docker protegidos) e não devem ter acesso contínuo a dados privados do ambiente.

O Moltbook é divertido, mas perigoso. Cá entre nós? Ainda escutaremos muito sobre sistemas autônomos e supervisão humana. Anotem aí.

É um aviso alto para CISOs e líderes de tecnologia: O amanhecer da era dos agentes autônomos está próximo, e se não estabelecermos governança instantânea, o próximo “vírus” de computador não será um código escrito por um hacker, mas uma “alucinação” executada por um assistente prestativo que você mesmo instalou.

Ricardo Brasil, Especialista em IA Responsável e Diretor de TI na GWS Engenharia

Colunista Café com Bytes | Tecnologia | Inteligência Artificial